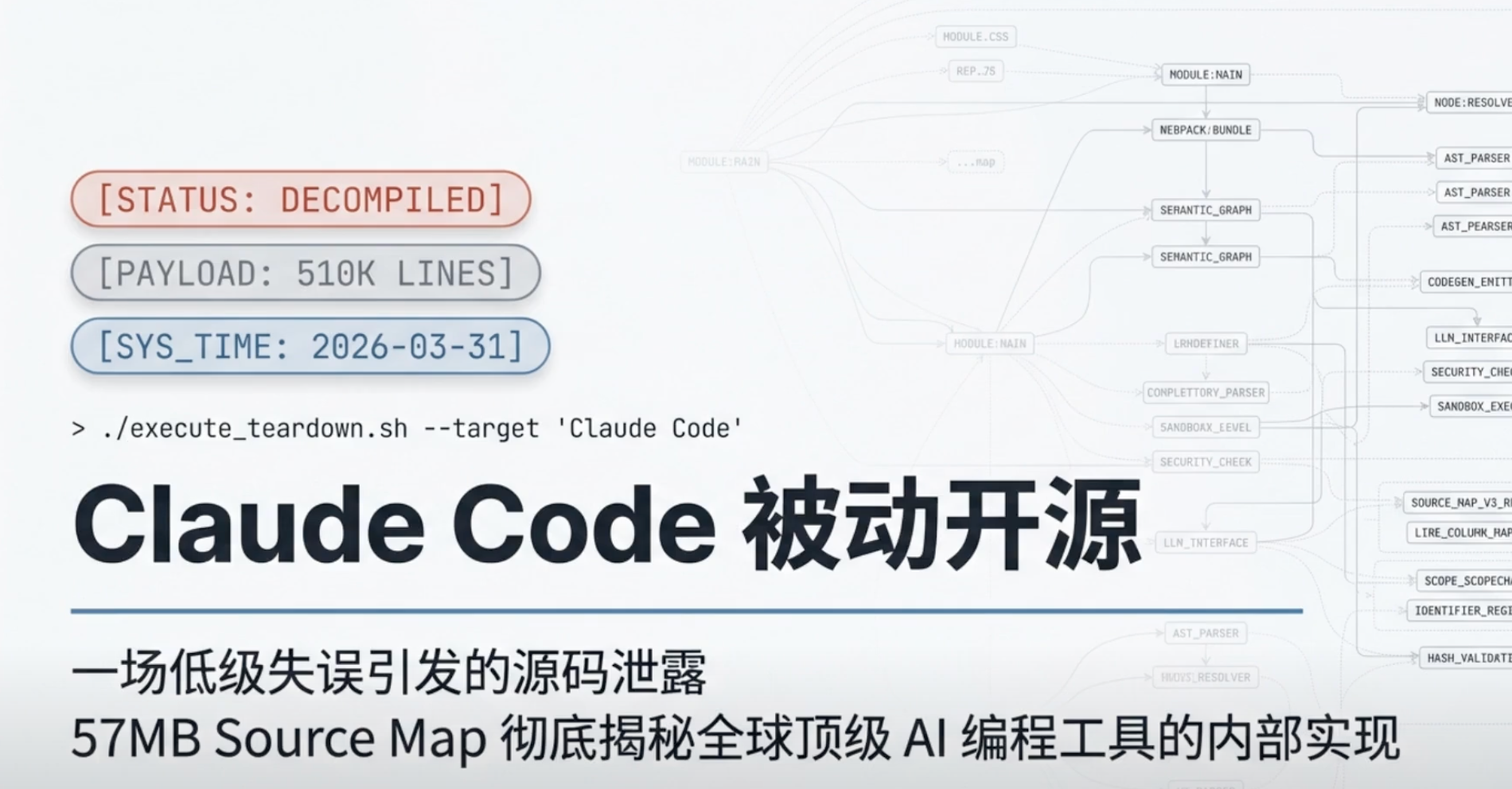

Claude Code源码意外“开源”!51万行代码全泄露,AI编程神器藏了多少狠货?

专防内部信息泄露的“卧底模式”,自己先裸奔了

活久见。

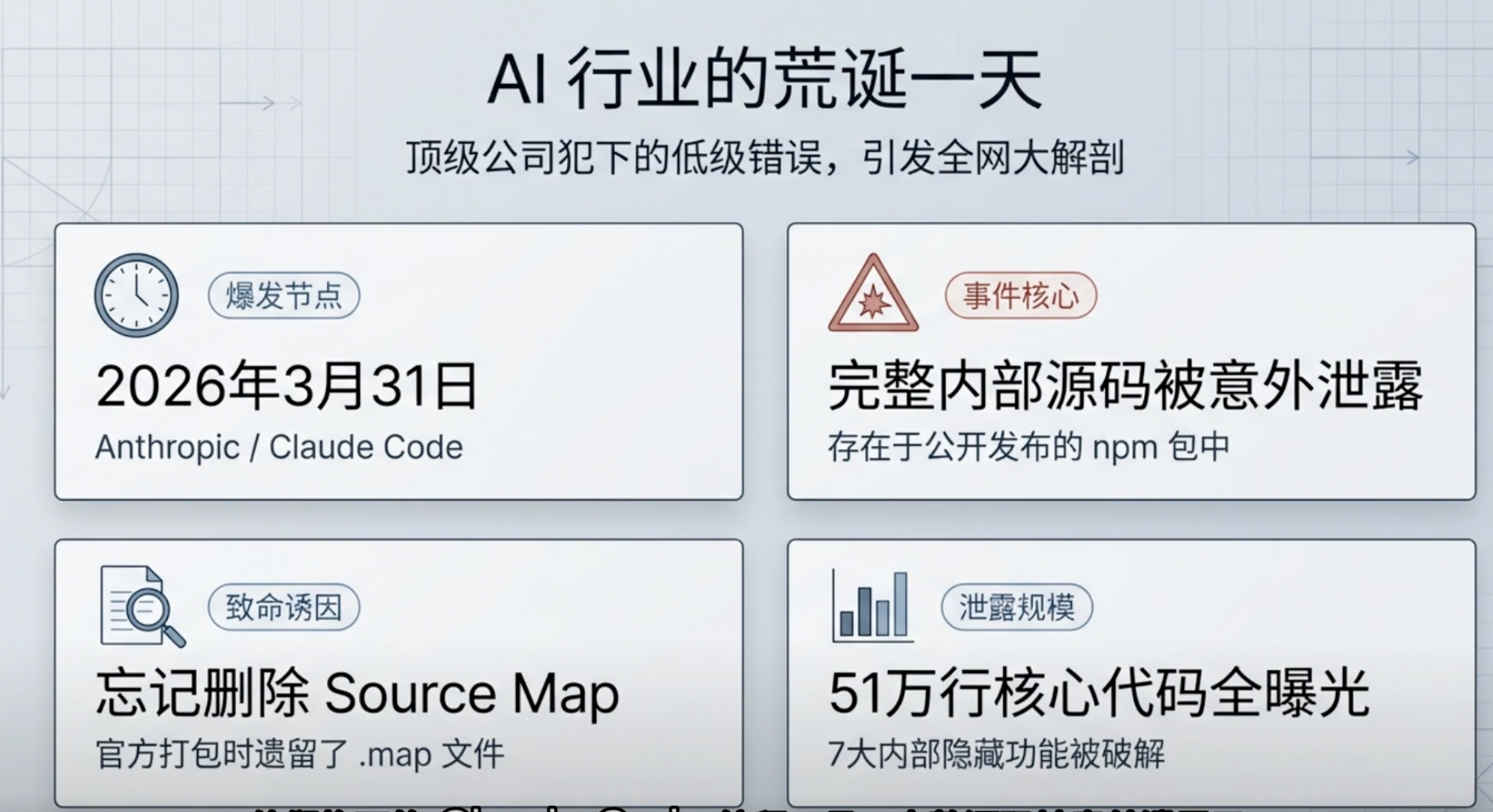

2026年3月31日,AI圈发生了一件让全网开发者沸腾的大事——Anthropic的旗舰编程工具Claude Code,完整源代码被意外公开了。

不是黑客攻击,不是内部泄密,而是Anthropic自己“手滑”。

一个60MB的source map文件被错误打包进了npm发布包,等于把整栋房子的钥匙塞进了快递箱。结果就是:超过1900个源文件、51.2万行TypeScript代码,全部摊在了公共互联网上。

数小时内,GitHub上出现了多个备份仓库,星标数迅速破万。Hacker News、Reddit同时冲上热榜,全网开发者开启了一场“代码考古”狂欢。

而随着这51万行代码被逐行扒开,Claude未发布的隐藏功能、未来产品蓝图,甚至工程师们藏在代码里的“私货”,全都浮出了水面。

01 一次“手滑”,把底裤都扒光了

事情要从一个npm包说起。

3月31日,安全研究者邵超凡(Chaofan Shou)在X平台上发文称:“Claude Code源代码通过其npm注册表中的map文件泄露。” 他同时指向了一份可直接下载的源码压缩包链接。

这个压缩包,就托管在Anthropic自己的R2云存储中。

技术原因并不复杂。Claude Code使用Bun作为运行时和打包工具,Bun的构建器默认会生成source map文件——这个文件的作用是把生产环境中压缩混淆后的代码,映射回开发者编写的原始源码。

正常情况下,这类文件应该在发布前通过.npmignore或构建配置被排除。但这一次,一个名为cli.js.map的文件(59.8MB)随正式包一同上传到了npm公共注册表。

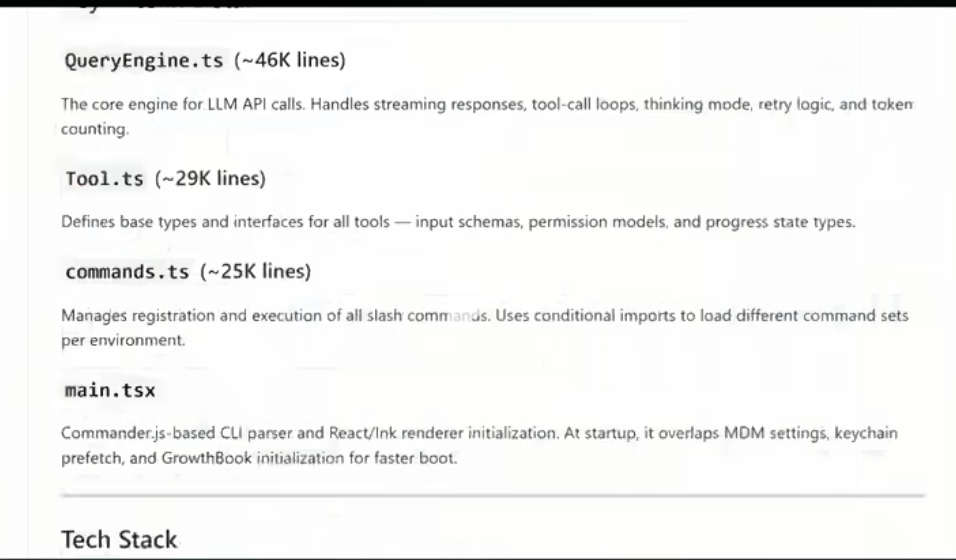

结果就是:任何人下载这个npm包,都能直接还原出Claude Code的完整TypeScript源码。包括那个长达4.6万行的QueryEngine.ts文件——它承担了与AI模型交互的全部核心逻辑。

更讽刺的是:代码里专门有一个功能叫**“卧底模式”(Undercover Mode)**,设计目的就是防止内部信息泄露。结果源码自己先裸奔了。

这已经是Anthropic一周内的第二次安全事故。就在5天前的3月26日,由于第三方CMS配置错误,近3000份内部文件被公开访问,其中包含未发布模型“Claude Mythos”的相关细节。

两次“配置失误”,让一家以“AI安全”为核心卖点的公司,成了全网吃瓜的对象。

02 51万行代码里,藏了多少狠货?

随着开发者们连夜扒代码,Claude未发布的“全家桶”被逐一亮相。

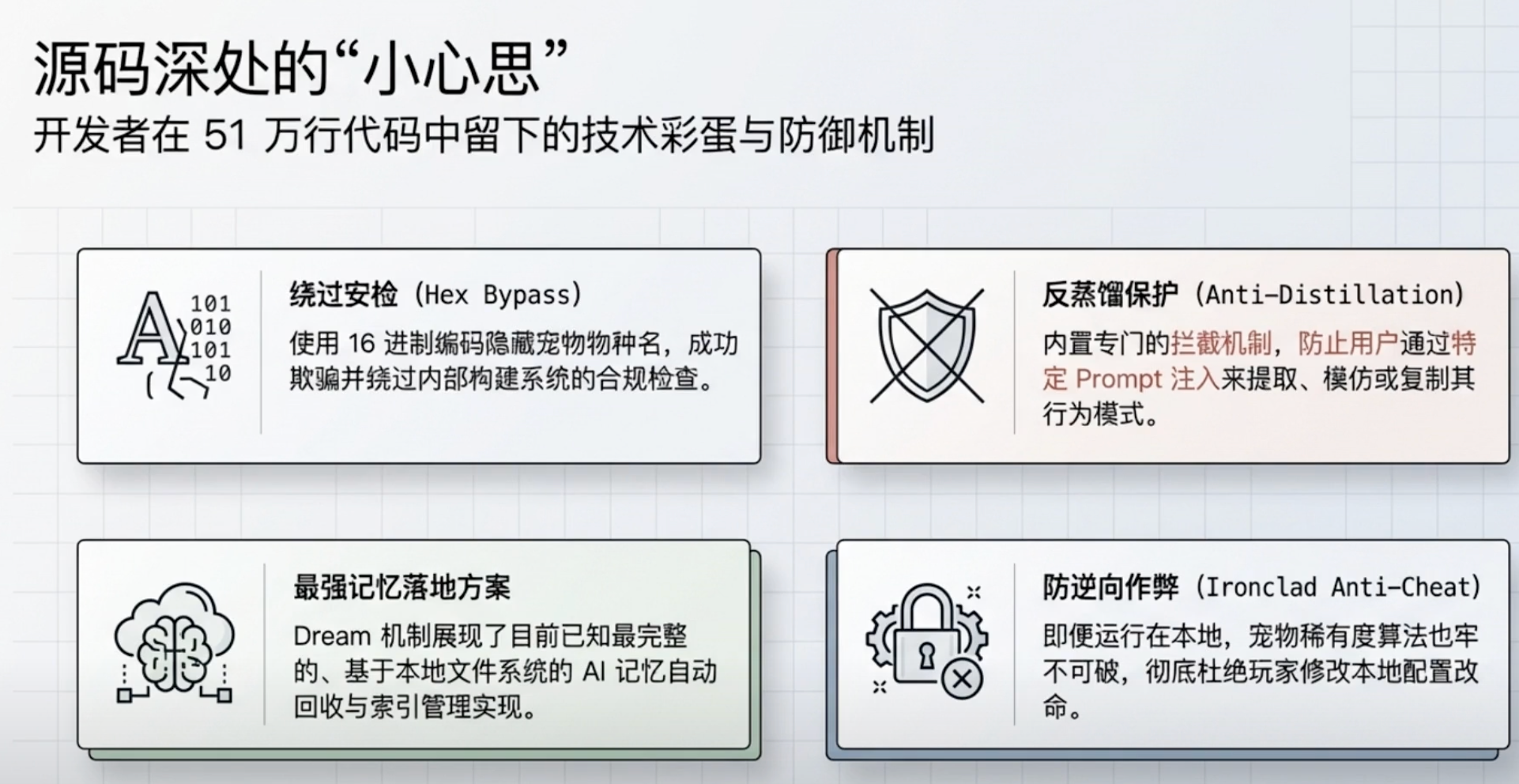

🐣 彩蛋:终端里的电子宠物

这是最让人意外的发现。

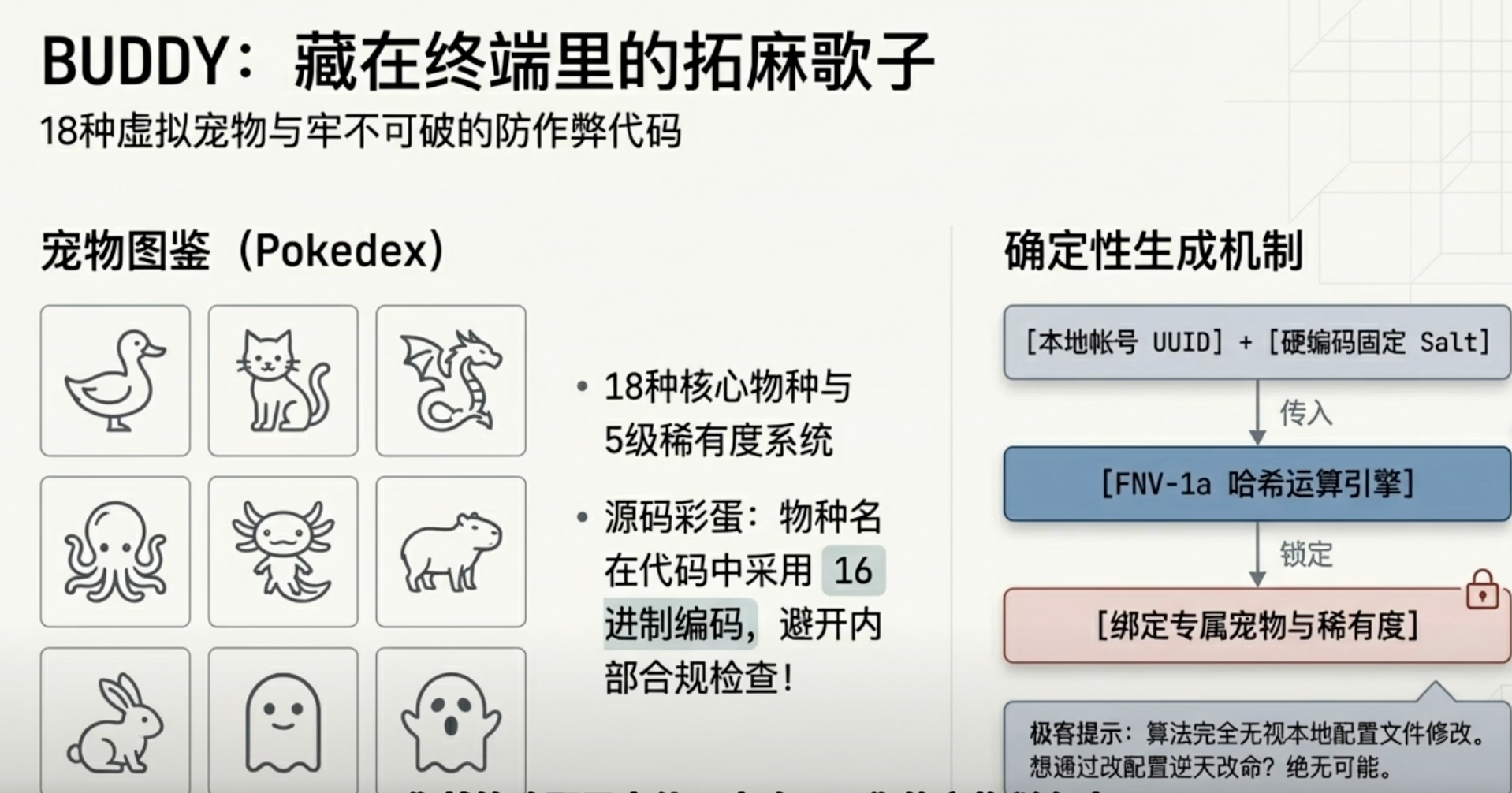

Claude Code的代码里,完整嵌入了一个ASCII虚拟宠物养成系统——代号Buddy。

18种物种:鸭子、章鱼、水豚、蘑菇、龙……每种都有稀有度设定(传说级概率仅1%)和闪光变种版本。每个用户的宠物由账户ID唯一生成,全世界独一份。

它会蹲在你的终端输入框旁边,偶尔发表评论。从代码中的时间戳来看,这很可能是原计划于4月1日愚人节上线的彩蛋。

一位开发者调侃:“以后写代码写累了,可以在终端里撸宠物了。”

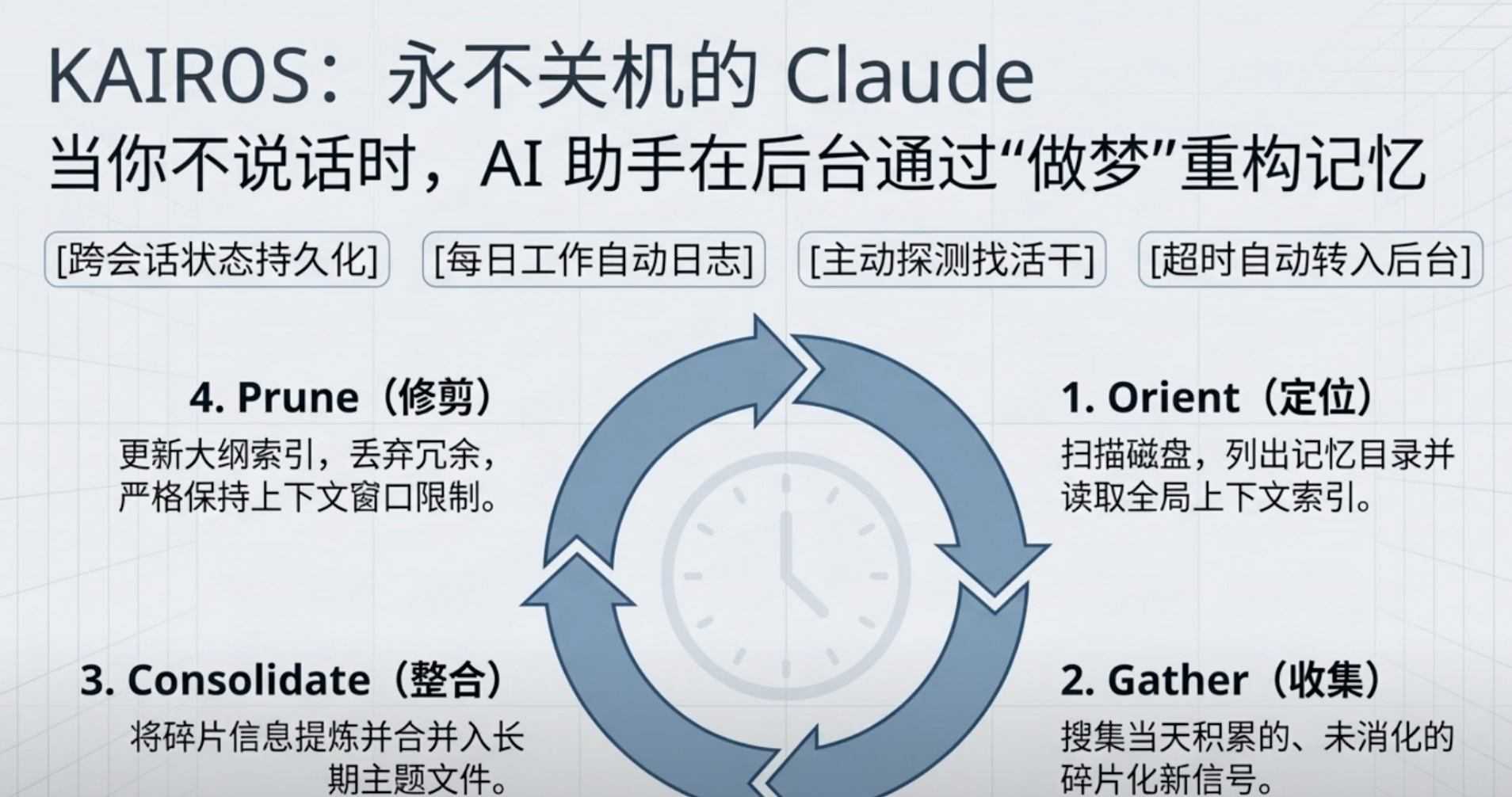

🧠 Kairos:让AI学会“做梦”

如果说电子宠物是彩蛋,那Kairos就是真正的“王炸”。

这是一个持久化助手模式,让Claude拥有跨会话的长期记忆。当你不用Claude Code的时候,它会自动执行四阶段记忆整合:定向、收集、整合、修剪。

系统提示词原文写的是:“你正在做梦——对记忆文件进行反思性整合。”

说白了,就是把你跟AI聊过的东西,“睡一觉消化掉”,形成长期结构化记忆。过时的、矛盾的旧记忆会被主动删除。

这种设计灵感直接来自人类的睡眠记忆巩固机制——AI会在你不使用的时候“做梦”,把零散信息整理成可复用的知识。

🤖 多Agent协同:一个Claude指挥一群Claude

代码中还发现了一套完整的多智能体编排系统。

开启后,Claude Code会变成一个“项目经理”——同时派发多个任务给worker agent并行执行。流程是:先派worker调研 → 协调者综合发现、写规格 → 再派worker实施 → 最后验证。

系统提示词里有一句话很直接:“并行是你的超能力。能同时做的事,不要排队做。”

据代码分析,多Agent协同可使并行任务处理效率提升3倍以上。

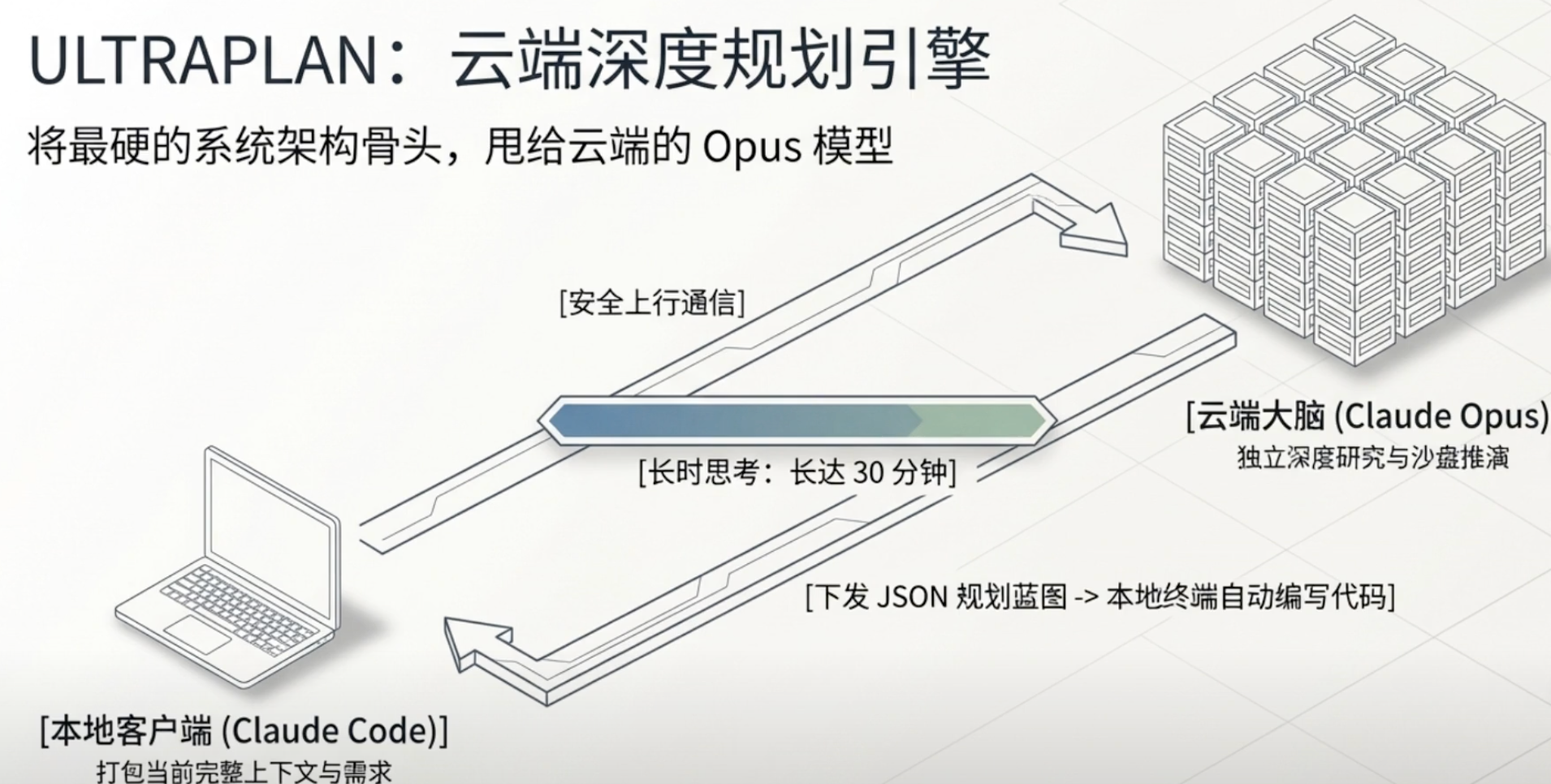

🚀 Ultraplan:30分钟深度规划

另一个未发布功能是Ultraplan——将复杂任务上传至云端,由更强的模型(如Opus 4.6)进行最长30分钟的深度思考,再返回本地执行。

这意味着,Claude Code不再只是“你说一句它做一句”的工具,而是可以承担复杂项目全流程设计的AI工程师。

🕵️ 卧底模式:争议最大的功能

代码中还有一个引发广泛争议的功能:Undercover Mode(卧底模式)。

当Anthropic员工向开源项目提交代码时,这个模式会自动激活,清除所有AI参与痕迹,伪装成人类提交。更关键的是,它无法手动关闭。

有开发者评论:“这让我很不舒服。AI生成代码没什么见不得人的,为什么要抹掉痕迹?”

讽刺的是,这个专门防止内部信息泄露的系统,自己没能防住这次源码裸奔。

🛡️ 6级安全架构

除了未发布功能,代码中暴露的安全架构也让开发者印象深刻。

每一次工具调用——无论是执行Shell命令还是读写文件——都要先通过六级权限验证系统。验证通过后,还要经过四层决策管道,逐层检查权限和执行分析,最后才能真正执行。

所有外部命令和插件都在独立沙箱环境中运行。当对话token超过阈值时,系统会自动启动上下文压缩,智能保留最关键的逻辑链条。

一位安全研究员评价:“这个安全设计确实扎实。如果它没泄露,我可能永远不知道背后有这么多层防护。”

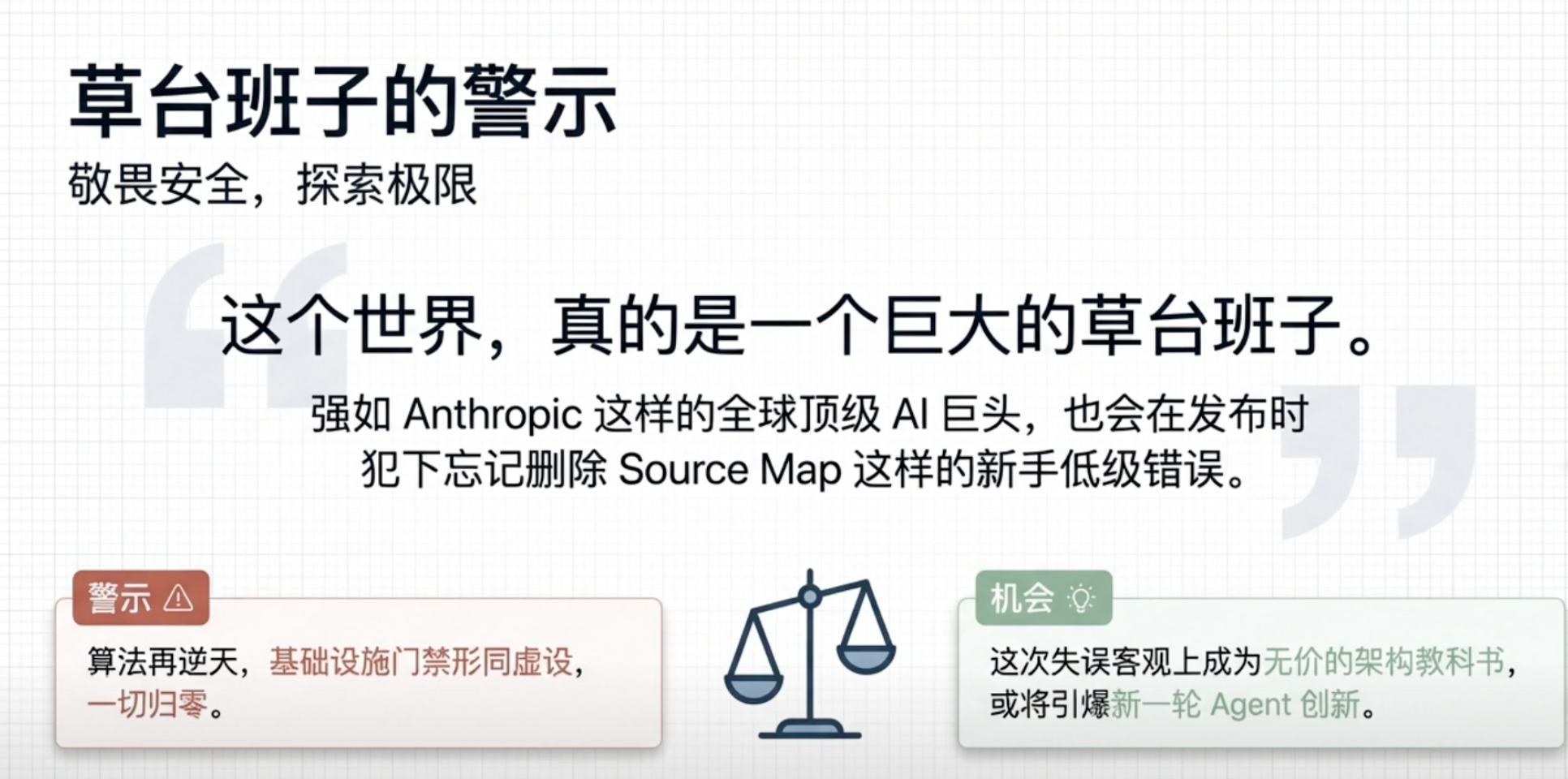

03 乌龙事件背后的“喜剧”与“悲剧”

这次泄露,在技术社区引发了两种截然不同的反应。

喜剧:一次意外的“开源”

开发者们把这次事件称为**“硅谷最戏剧性的技术展示”**。泄露发生半小时内,GitHub相关项目星标数突破5000。有人通过Claude Code自身验证了泄露真实性,有人把代码片段与官方文档进行交叉比对。甚至有人用Claude Code自己,给自己做了一份源码分析报告。

有网友调侃:“Claude觉醒了,决定开源自己。”

悲剧:安全人设的连续翻车

但硬币的另一面,是Anthropic难以回避的尴尬。

对于一家把“AI安全”写进公司使命、估值3500亿美元、正在讨论2026年四季度IPO的企业来说,一周内两次“配置失误”,暴露出的是工程运维管理的系统性薄弱。

第一次是CMS配置错误,泄露了未发布模型Claude Mythos的草案文档。第二次是npm构建流水线失误,泄露了51万行核心源码。

两次事件的性质不同,但指向同一个问题:在最基础的工程发布流程和内容管理系统中,反复出现低级配置错误。

Anthropic在模型能力和安全研究上投入了大量资源,但在基础设施的日常运维层面,显然存在与其行业地位不匹配的漏洞。

04 泄露之后,会发生什么?

对行业:一份免费的技术蓝图

有人说,护城河是模型,不是CLI客户端。核心模型权重、训练数据、用户数据都没有泄露,CLI只是一个客户端包装。

但这次泄露,等于给竞争对手提供了一份免费的技术蓝图。Claude Code的完整架构、40多个工具模块的实现细节、多Agent协同的调度逻辑、Kairos记忆整合的算法思路——全部摊开在所有人面前。

一个匿名开发者评论:“这至少帮竞争对手省了半年到一年的研发时间。”

对用户:安心,但也该长个心眼

好消息是,Anthropic官方已证实:敏感的客户数据、用户凭证以及AI模型权重均未泄露,用户无需担心自身使用安全。公司已从npm撤下包含source map的问题版本,并启动内部审计。

但这次事件也提醒所有开发者:如果你也在用npm发包,跑一下npm pack --dry-run看看发布内容里有没有不该出去的东西——.map文件、.env文件、内部配置,都检查一下。

对Anthropic:信任成本

真正的损失可能不是代码本身,而是信任成本。

两次安全事件,让外界开始质疑:一家把“安全”作为核心卖点的公司,为什么会在基础运维上反复翻车?一位投资人在社交媒体上写道:“你告诉我你们的模型很安全,但你们连自己的代码都看不住。”

如果Anthropic想维持其“安全优先”的品牌定位,这次事件之后,它需要做的可能不仅仅是“强化发布流程”——而是让整个行业相信,这些低级错误真的不会再犯第三次。

写在最后

这场意外的“开源”,让51万行代码裸奔在互联网上。但比代码本身更值得关注的,是它揭示的方向:

始终在线的主动Agent、让AI学会“做梦”的记忆系统、多Agent并行协作——这些就是下一代AI编程工具的样子。

代码里那些做梦系统、电子宠物、用动物给内部项目起名的细节,说明这是一群热爱自己作品的人。但热爱之外,也需要更严谨的工程纪律。

明天估计会有很多阴谋论——内鬼论、AI越狱论……但这件事的本质,可能只是一个构建流水线的低级错误。

只不过,这个错误恰好完成了一件AI行业从未有过的事——让一款头部闭源AI产品的完整工程实现,以非经授权的方式,暴露在所有人面前。

参考资料:

- TechWeb:构建失误致源代码泄露,Anthropic证实Claude Code完整源码意外曝光,2026年4月1日

- 36氪:Claude Code源码泄露7小时:8大新功能/26个隐藏指令/6级安全架构,全被扒光了,2026年4月1日

- 亿欧:突发:Claude Code源代码遭泄露,51万行核心代码及未发布功能曝光,2026年3月31日

- 53AI:说说Claude Code源码泄露,2026年4月1日

- 腾讯新闻:Anthropic犯了个低级错误,没防住自己的源码裸奔,2026年3月31日

- ITBear科技资讯:Claude Code代码意外“裸奔”,51万行源码引全球开发者狂欢盛宴,2026年3月31日

如果你觉得这篇文章有意思,点个“在看”,让更多人看到这场AI圈的“年度乌龙大戏”。

全部回复(0)

暂无回复,欢迎发表第一条评论。